Cómo la IA Mejora el Análisis de Encuestas Académicas

28 ene 2026

IA que acelera y mejora la limpieza, el análisis de texto y la detección de patrones en encuestas académicas, con énfasis en privacidad y supervisión humana.

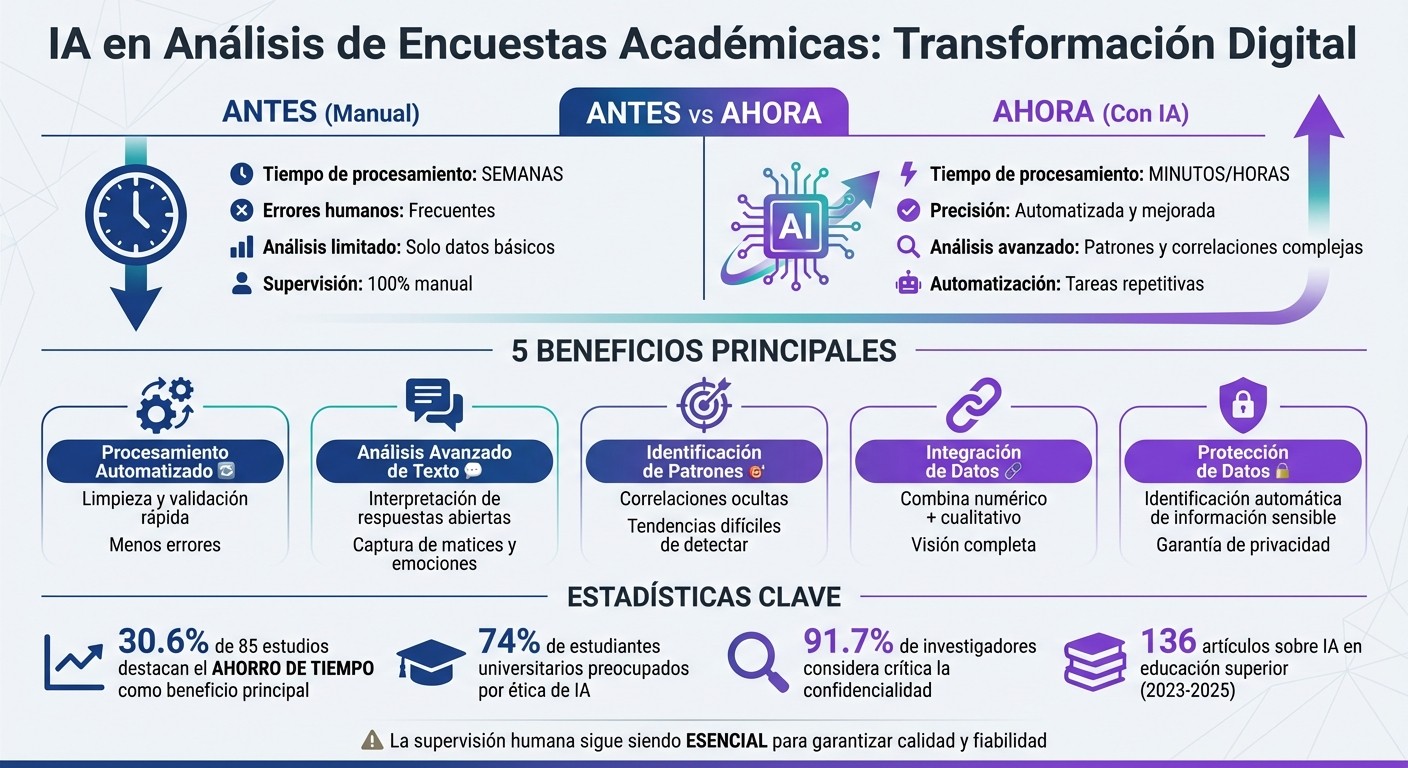

La inteligencia artificial (IA) está transformando cómo se analizan las encuestas académicas, reduciendo drásticamente el tiempo necesario para procesar datos y mejorando la precisión en los resultados. Antes, los investigadores pasaban semanas limpiando información y analizando respuestas abiertas. Ahora, herramientas basadas en IA completan estas tareas en minutos, permitiendo un enfoque en análisis más profundos y decisiones mejor fundamentadas.

Principales beneficios de la IA en el análisis de encuestas:

Procesamiento automatizado: Limpieza y validación de datos con mayor rapidez y menos errores.

Análisis avanzado de texto: Interpretación de respuestas abiertas, capturando matices y emociones.

Identificación de patrones: Descubrimiento de correlaciones y tendencias difíciles de detectar manualmente.

Integración de datos: Combina información numérica y cualitativa para ofrecer una visión más completa.

Protección de datos: Identificación automática de información sensible para garantizar la privacidad.

Aunque la IA ofrece ventajas claras, también plantea desafíos éticos, como sesgos en los datos y falta de transparencia en los resultados. La supervisión humana sigue siendo esencial para garantizar la calidad y fiabilidad de los análisis. Usar estas herramientas de forma responsable puede revolucionar la investigación académica, pero requiere formación y un enfoque crítico por parte de los investigadores.

Análisis de Encuestas: Manual vs IA - Comparación de Tiempos y Beneficios

Cómo la IA Automatiza el Procesamiento de Datos de Encuestas

El procesamiento manual de datos de encuestas académicas siempre ha sido un desafío que consume tiempo y recursos, limitando el alcance de muchos estudios. Roberto E. Ramos-Rivera, investigador de la Universidad de Colima, lo resume perfectamente:

"Procesar estos datos manualmente consume mucho tiempo y restringe el análisis en profundidad" [6].

La llegada de la inteligencia artificial (IA) ha transformado este panorama. Ahora, tareas repetitivas que antes llevaban semanas pueden completarse en cuestión de horas, permitiendo a los investigadores centrarse en análisis más complejos y estratégicos. Este cambio no solo acelera los procesos, sino que también mejora la calidad de las decisiones académicas. Veamos cómo la IA está automatizando los aspectos clave del procesamiento de datos.

Los algoritmos de machine learning son capaces de aprender patrones a medida que procesan datos, lo que les permite mejorar su precisión con el tiempo [7]. Gracias a esta capacidad, estos sistemas pueden identificar tendencias, correlaciones y patrones que podrían pasar desapercibidos incluso para los investigadores más experimentados. Además, al reducir la carga de trabajo, los plazos entre la recopilación de datos y la toma de decisiones se acortan considerablemente, liberando recursos humanos para actividades más estratégicas [6][5].

Limpieza y Validación Automatizada de Datos

Una de las tareas más críticas en el análisis de encuestas es la limpieza de datos, y la IA ha demostrado ser una herramienta invaluable en este ámbito. Con su capacidad para detectar y corregir errores, valores faltantes e inconsistencias, asegura que los datos sean precisos y fiables. Los sistemas automatizados pueden analizar grandes volúmenes de información, identificando anomalías y preparando los datos para análisis más rigurosos. Esto no solo ahorra horas de trabajo manual, sino que también minimiza el riesgo de errores humanos.

Además, la IA facilita la monitorización constante y la generación de datos simulados, lo que acelera la creación de modelos predictivos. Según investigadores de Frontiers in Education:

"La IA puede ayudar a acelerar los procesos de investigación mediante datos simulados para crear modelos predictivos, facilitando los procesos de toma de decisiones" [5].

Análisis de Texto y Sentimiento en Respuestas Abiertas

Una vez que los datos están limpios, la IA puede abordar el análisis de respuestas abiertas, interpretando matices y emociones que antes eran difíciles de captar. Herramientas avanzadas como los Modelos de Lenguaje de Gran Escala (LLM) y el Procesamiento del Lenguaje Natural (PLN) permiten analizar respuestas cualitativas con un nivel de detalle que supera lo que se podía lograr manualmente o con software básico [6].

Estas tecnologías modernas utilizan arquitecturas de transformadores con mecanismos de autoatención, que calculan las relaciones entre palabras incluso cuando están separadas dentro del texto. Esto permite capturar estructuras complejas y contextos más profundos [2]. Los sistemas convierten las palabras en representaciones numéricas (embeddings), lo que facilita la identificación de asociaciones semánticas y agrupaciones temáticas. Palabras con significados similares se agrupan en el espacio vectorial, haciendo más sencillo detectar patrones y analizar sentimientos en las respuestas [2].

Por último, técnicas como el Aprendizaje por Refuerzo con Retroalimentación Humana (RLHF) ajustan estos modelos a contextos académicos específicos, mejorando tanto el estilo como el razonamiento en investigaciones especializadas [2]. Esto representa un avance significativo en la capacidad de los investigadores para interpretar datos cualitativos con precisión y profundidad.

Análisis Impulsado por IA para Obtener Perspectivas Más Profundas

En el ámbito académico, la IA está transformando la manera en que se interpretan los datos recopilados. Una vez procesados y organizados, los sistemas basados en IA van mucho más allá del análisis descriptivo tradicional. Lo que realmente destaca es su habilidad para detectar patrones y conexiones que los métodos convencionales no logran identificar. Los algoritmos actuales trabajan en múltiples etapas, explorando grandes volúmenes de datos y ajustando sus métodos en tiempo real a medida que encuentran nueva información [4].

Como afirma OpenAI:

"La capacidad de sintetizar conocimiento es un requisito previo para crear nuevo conocimiento" [4].

Esto significa que la IA puede consolidar datos provenientes de cientos de fuentes distintas en informes detallados, una tarea que, de forma manual, requeriría horas de búsqueda en diferentes sitios web [4]. En febrero de 2025, OpenAI presentó "deep research" en ChatGPT, una herramienta diseñada para realizar investigaciones en múltiples pasos, mostrando su capacidad para manejar datos complejos y ofrecer recomendaciones precisas [4]. Estos avances están redefiniendo cómo se descubren correlaciones y tendencias significativas.

Identificación de Correlaciones y Tendencias

Los algoritmos avanzados de IA utilizan herramientas estadísticas complejas, como la "regresión aparentemente no relacionada" o el "modelado de ecuaciones estructurales" (SEM), para identificar factores que influyen en áreas como el rendimiento académico o la adopción tecnológica [9]. Estos sistemas no solo detectan relaciones evidentes, sino también conexiones más sutiles que podrían pasar desapercibidas [4].

El modelo "deep research" de OpenAI ha demostrado un rendimiento sobresaliente en pruebas que evalúan preguntas avanzadas en más de 100 materias [4]. Gracias a su capacidad de razonamiento, los investigadores pueden crear modelos predictivos basados en datos simulados, acelerando la detección de tendencias y facilitando decisiones complejas [5].

Integración de Múltiples Formatos de Datos

Además de identificar correlaciones, la IA destaca por su habilidad para combinar diferentes tipos de datos y ofrecer una visión integral. Es capaz de unir información numérica, textual y categórica, fusionando análisis cualitativos y cuantitativos [3]. Esta capacidad multimodal permite analizar texto, imágenes y PDFs de manera simultánea, generando informes unificados y visualizaciones detalladas [4].

Con herramientas basadas en Python, la IA puede crear y perfeccionar visualizaciones avanzadas, ayudando a los investigadores a identificar patrones que serían imposibles de detectar utilizando hojas de cálculo convencionales [4]. En una revisión de 85 estudios, un 30,6% destacó el ahorro de tiempo como el beneficio más común de usar IA en investigación [5]. Un ejemplo práctico es un estudio realizado en la Universidad Complutense de Madrid, que analizó 4.800 respuestas de estudiantes para evaluar la percepción de la IA como fuente de información. Este análisis demostró cómo la integración de datos diversos puede ofrecer nuevas perspectivas sobre la adopción de la tecnología [3].

Mejorando la Integridad y Accesibilidad de la Investigación

Además de procesar datos, la IA juega un papel clave en proteger la ética y facilitar el acceso a la investigación. Hoy en día, los sistemas avanzados pueden identificar automáticamente información sensible y datos personales (PII), garantizando la privacidad incluso en grandes volúmenes de datos. Por ejemplo, en enero de 2025, NVIDIA presentó su línea de modelos Nemotron Safety, que incluye el modelo Nemotron PII, diseñado para detectar datos sensibles con alta precisión. Este modelo ya ha sido adoptado por empresas como CrowdStrike y Fortinet para reforzar el cumplimiento ético en sus aplicaciones de IA [8].

IA en la Revisión por Pares y el Control de la Integridad

Más allá de la protección de datos, la IA también está transformando la revisión académica al reforzar la integridad de los procesos. Los algoritmos actuales son capaces de detectar diferentes tipos de sesgos en los datos, como el sesgo de medición (datos incompletos), el sesgo de exclusión (omisión de variables importantes) y el sesgo de muestreo (datos no representativos) [10]. James Holdsworth, de IBM, destaca:

"El sesgo reduce la precisión de la IA y, por lo tanto, su potencial" [10].

Además, estas herramientas son útiles para identificar plagio y referencias fabricadas en trabajos académicos, aspectos esenciales para mantener la calidad y la credibilidad de la investigación [2, 17].

Sin embargo, el uso de la IA en la revisión por pares sigue siendo un tema delicado. Según un estudio, el 91,7% de los investigadores considera que emplear IA en este proceso es una violación grave de la confidencialidad. No obstante, el mismo porcentaje acepta su uso para sugerir o clasificar referencias, siempre que se realice una verificación manual [1]. La supervisión humana sigue siendo imprescindible. El International Committee of Medical Journal Editors (ICMJE) subraya:

"Toda salida de IA debe ser revisada por el equipo investigador; se exige juicio experto para evitar errores, sesgos o inferencias no justificadas" [1].

Eliminando Barreras Lingüísticas y Técnicas

La IA también está ayudando a superar barreras lingüísticas y técnicas en el análisis de encuestas y la producción académica. Los modelos multilingües actuales facilitan a los investigadores no nativos la traducción y corrección de textos, mejorando significativamente la escritura académica [13]. Un ejemplo es Estilector, una herramienta gratuita en línea que ofrece corrección automática de textos académicos en español, junto con retroalimentación formativa y referencias bibliográficas. Un diagnóstico realizado en una universidad mostró que el 86% de los estudiantes tenía un nivel inicial de "No alcanzado" en producción escrita, destacando la importancia de este tipo de apoyo [12].

En 2025, Bosch implementó los modelos Nemotron Speech de NVIDIA, que incluyen subtítulos automáticos y reconocimiento de voz en tiempo real para mejorar la accesibilidad [8]. Estas innovaciones permiten que equipos de investigación diversos analicen encuestas y presenten sus resultados sin que las diferencias de idioma o habilidades técnicas sean un obstáculo. Sin embargo, aunque estas herramientas avanzan rápidamente, también plantean nuevos desafíos que deben abordarse con cuidado.

Desafíos y Uso Responsable de la IA en la Investigación Académica

Aunque la inteligencia artificial ha transformado el análisis de encuestas, también plantea retos éticos que no pueden ignorarse si queremos mantener la integridad en la investigación. Por ejemplo, la IA puede generar resultados que parecen fiables pero que, en realidad, son falsos, incluyendo citas bibliográficas inventadas [5][2]. Esta capacidad ha llevado a expertos a emitir advertencias contundentes:

"La inteligencia artificial puede generar artículos científicos médicos fraudulentos pero de apariencia auténtica: se ha abierto la caja de Pandora" – Májovský et al. [5]

Otro desafío importante es la falta de transparencia en las fuentes de datos que utiliza la IA, lo que dificulta la verificación de sus conclusiones [11]. Además, los sesgos inherentes en los datos de entrenamiento pueden amplificarse en los resultados, afectando la calidad del análisis [2].

Las preocupaciones éticas en torno a la IA son amplias. Según encuestas, el 74% de los estudiantes universitarios está preocupado por el impacto ético de la IA, mientras que el 79% teme por cuestiones de seguridad y privacidad [14]. En España, un 72% de la población identifica la manipulación de la información como una de las principales amenazas en el ámbito educativo [16]. Además, una revisión de 85 estudios publicados en 2023 destacó que 21 de ellos señalaban la ética, el plagio y la falta de transparencia como los problemas más frecuentes [5]. Para enfrentar estos desafíos, es crucial implementar estrategias que refuercen la transparencia y reduzcan los sesgos.

Transparencia y Reducción del Sesgo

Es esencial que los investigadores utilicen la IA respetando los códigos éticos de sus instituciones y las políticas de integridad académica, especialmente para abordar problemas como la suplantación de autoría y la protección de datos [11]. Cole Stryker, de IBM, advierte:

"Los LLM pueden reflejar y amplificar sesgos presentes en sus datos de entrenamiento, produciendo resultados que son injustos u ofensivos" [2]

Para minimizar estos riesgos, se han propuesto varias técnicas. Por ejemplo, el "red-teaming" busca provocar deliberadamente respuestas inseguras o sesgadas para identificar y corregir las debilidades del modelo [2]. También se recomienda utilizar modelos con capas de seguridad integradas, diseñados para detectar información sensible [8], y aplicar métodos como la Generación Aumentada por Recuperación (RAG), que conecta modelos preentrenados con bases de datos verificadas para mejorar la precisión [2].

La Necesidad de Supervisión Humana

La supervisión humana sigue siendo indispensable para garantizar un uso responsable de la IA. Según un estudio publicado en Frontiers in Education:

"La supervisión humana sigue siendo necesaria para poder establecer con ojo crítico y análisis exhaustivo cuándo los elementos han sido producidos con inteligencia artificial en su totalidad y, por lo tanto, constituyen fraude" [5]

Esto se refleja en la percepción pública: solo el 30% de las personas confiaría en un diagnóstico médico realizado únicamente por IA, sin intervención humana [17]. Además, el 60% considera que los docentes no tienen la formación adecuada para manejar la IA de manera efectiva [16].

Por ello, los investigadores deben revisar manualmente todas las citas y argumentos generados por IA, usar esta tecnología como un complemento y no como un sustituto, y fortalecer sus habilidades técnicas en áreas como estadística y programación. Esto les permitirá comprender mejor cómo funcionan los modelos de IA, identificar posibles sesgos y garantizar que los resultados sean fiables [15].

Conclusión

La inteligencia artificial se ha convertido en una herramienta clave para transformar el análisis de encuestas académicas. Según una revisión sistemática de 85 artículos, el ahorro de tiempo es la ventaja más destacada, mencionada en 26 estudios [5]. Tareas que antes podían tardar días en completarse manualmente ahora se realizan en cuestión de minutos u horas [5][4].

Modelos avanzados como GPT-4 han demostrado ser especialmente útiles para interpretar respuestas abiertas. Estos ofrecen resultados con mayor coherencia, mejor organización del discurso y una riqueza léxica superior, lo que mejora la calidad de las investigaciones [6][13]. Esto, a su vez, facilita una toma de decisiones más informada a nivel institucional [6][4].

Sin embargo, aprovechar al máximo estas herramientas requiere un uso responsable. La supervisión humana sigue siendo indispensable para verificar datos, identificar posibles sesgos y garantizar la fiabilidad de los resultados. En este contexto, se recomienda fomentar la "formación crítica en IA generativa" (C-GAI-L), un enfoque que combina pensamiento crítico y autoaprendizaje para evaluar estas tecnologías de manera ética [13].

La IA puede ser especialmente útil en tareas específicas como la limpieza de datos o el análisis de sentimientos, pero siempre debe haber una verificación manual de los resultados. Además, el interés en la aplicación de la IA en la educación superior está creciendo rápidamente: en solo 27 meses (2023-2025), se identificaron 136 artículos relevantes sobre el tema [13]. Integrar la IA de manera reflexiva y supervisada no solo mejora la eficiencia del análisis, sino que también asegura la precisión y la integridad de los resultados de la investigación.

FAQs

¿Cómo protege la IA la privacidad de los datos en el análisis de encuestas académicas?

La inteligencia artificial protege la privacidad en el análisis de encuestas académicas mediante el uso de técnicas como la anonimización y la encriptación de datos. Estas herramientas aseguran que la información personal de los participantes no pueda ser identificada ni utilizada de manera indebida, cumpliendo con normativas como el RGPD en Europa.

También se emplean principios como la minimización de datos, limitando la recopilación a lo estrictamente necesario, y algoritmos diseñados para evitar el almacenamiento permanente de información sensible. Estas medidas, combinadas con estándares éticos y protocolos claros, garantizan un análisis seguro y respetuoso con la privacidad, en línea con las mejores prácticas internacionales.

¿Cuáles son los principales retos éticos del uso de la inteligencia artificial en la investigación académica?

El empleo de la inteligencia artificial en la investigación académica trae consigo varios retos que no podemos ignorar. Uno de los más importantes es el de la integridad académica, ya que herramientas como las IA generativas permiten crear textos de forma automática, lo que abre la puerta a preocupaciones sobre el plagio y la falta de originalidad en los trabajos.

Por otro lado, el mal uso de estas tecnologías puede comprometer la honestidad y la transparencia en la creación de conocimiento, generando dudas sobre quién es realmente el autor y qué tan fiables son los resultados presentados. También es fundamental prestar atención a la protección de datos y asegurar la igualdad en el acceso a estas herramientas, para evitar que se amplíen las brechas existentes.

En este contexto, resulta imprescindible establecer marcos éticos y normativos que velen por un uso responsable de la IA. Solo así podremos garantizar que estas tecnologías se utilicen respetando los valores académicos y fomentando un ambiente de investigación confiable y justo para todos.

¿Por qué es importante la supervisión humana en el análisis de encuestas con IA?

La supervisión humana juega un papel clave cuando se utiliza inteligencia artificial (IA) para analizar encuestas. ¿Por qué? Porque aunque la IA es increíblemente eficiente procesando grandes cantidades de datos, no siempre capta los matices contextuales o las particularidades culturales. Esto puede llevar a errores o incluso a sesgos en los resultados.

Aquí es donde los humanos marcan la diferencia. Aportan algo que las máquinas no pueden replicar: juicio crítico, sensibilidad y una comprensión profunda del contexto. Esto es especialmente importante en el ámbito académico, donde la ética y la equidad son valores fundamentales.

Cuando combinamos la rapidez y capacidad de la IA con la supervisión humana, logramos un análisis que no solo es eficiente, sino también riguroso y equilibrado. Este enfoque asegura que los resultados sean más fiables y que las decisiones tomadas estén basadas en un análisis sólido y responsable.